トピック2:レッスン5:ざっとAIの歴史を学んでおく(その3)

前回は”エキスパートモデルの限界と挫折”をざっと見てきた。

今回はいよいよ今のLLMが誕生する流れを詳しく見ていく。

復習:

エキスパートモデル=「人間がルールを書き足す時代」

LLM=「「何に注目すべきかを自動で学ばせてルールを半自動で作れる時代」

1.Googleの研究チームが発表した論文「注目こそすべて(Attention Is All You Need 2017)」とは?

この論文は2017年にGoogleの「翻訳システム」の研究チームが発表したもの。つまりAIに関するアカデミックな研究というより、翻訳という具体的なサービスについてのレポートだった。

で、このレポートの中で提案された以下の考え方が後のLLM誕生の直接的な契機になった。

※ちょっと難しいお話しだから、ざっと理解しておけばOK。

・Self‑Attention(自己注意)=文中のすべての単語に同時に注目する。

・並列処理=それまで単語は左から右へ1単語ずつしか処理できなかったけど、Self‑Attentionによって同時に並列的に単語を処理できるようになった。

・どこを見るか?の多角化=上記の2つが基盤となることで、大量のデータを精度高くかつ素早く処理できるようになった。具体的には1つの単語が持つ「情報」を飛躍的に多くすることが出来るようになった。

これらを行うモデルがTransformer(トランスフォーマー)と呼ばれて、今のChatGPTやGeminiもこのモデルが根本になっている。

ざっくりと例えるなら・・・

◆Transformer(トランスフォーマー)以前=バケツリレーの伝言ゲーム

翻訳者は、文章全体の単語を区切って(これがトークナイズ)バケツに入れられた単語(英語)を一つずつ順番に見て、最終的にそれぞれの単語に適した単語(日本語)を一つずつ出力する。

例文:

The anime you recommended to me was really interesting.

↓トークナイズを行う

The /anime/ you /recommended/ to/ me /was /really /interesting.

↓逐語的に翻訳

そのアニメ あなたが薦めてくれた私に は とても 面白かった

◆Transformer(トランスフォーマー)以降=文章全体をドローンで空撮

翻訳者は、文章全体の単語を区切って(これがトークナイズ)、プラカードに書かれた各単語をドローンで俯瞰して見て、最終的に英文に適した日本語訳を出力する。

例文:

The anime you recommended to me was really interesting.

↓トークナイズを行う(ここまではほぼ同じ処理)

The /anime/ you /recommended/ to/ me /was /really /interesting.

↓これを俯瞰して全体を見る

・”The”が注目する単語は名詞の確率が高いことを事前に学習している

・”anime”が注目する単語は”interesting”(面白い)や”terrible”(最悪)などの形容詞の確率が高いことを事前に学習している

・先頭に”The anime”という定冠詞つきの名詞(日本語なら”あのアニメ””例のアニメ”など)が来る場合、その直後にその名詞を修飾する関係代名詞節がくる確率が高いことを事前に学習している。

※The anime (名詞) you recommended to me(That/Whichが省略された関係代名詞説=修飾語)

・

・

・

・

・

こんな感じで各単語が他の単語にどのくらい注目するか?に焦点を当てたのがTransformer(トランスフォーマー)モデル。

↓全体を俯瞰して翻訳

あなたが薦めてくれたあのアニメは、めっちゃ面白かったよ!

ーーーーーーーーーーーーーー

2.これの何がすごかったのか?

元々は翻訳のために考え出されたシステムだったけど、数年であらゆる生成 AI の土台に昇格してしまったこと!

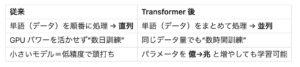

①スピードとスケールがケタ違いになった!

※ここで言うパラメータとは、さっき出てきた1つの単語が持つ「情報」のこと。

※ここで言うパラメータとは、さっき出てきた1つの単語が持つ「情報」のこと。

※GPUはいわゆる半導体のチップ(これで並列処理を行う)

結果:

データ×パラメータ×計算量をひたすら大きくするほど、性能が飛躍的にアップすることになった。

データ=これまでにデジタル化された全世界のすべてのテキスト

パラメータ=上記のテキストが持つ情報(トークナイズされた単語が持つ注目度などの情報)

計算量=上記を高速で並列計算しまくる

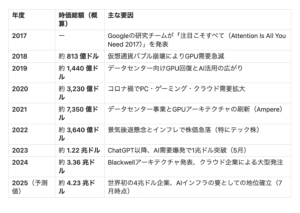

で、これらは行うのに最も必要なのが半導体チップ。特にGPUと呼ばれる当初は画像や動画処理のためにつくられたものの需要が爆発的に高まり、世界中で投資合戦がはじまった。

最高性能のGPU生産技術をもつアメリカのNVIDIA(エヌビディア)は、この流れによって歴史上初の4兆ドル企業にまで成長。(つまりGAFAM、GoogleとかAmazonとかappleとかより巨大)

NVIDIA 年末時価総額(2018年~2025年)

②マルチタスク(マルチモーダル)が行けちゃうようになった!

そもそも翻訳に関するモデルだったわけだけど、同じ仕組みを使うことで、要約・質問応答・コード生成など、タスクを変えても同じモデルを再利用出来るようになった。

ざっくり言うと、Self‑Attention(セルフアテンション)に着目したトランスフォーマーモデルは、「どこに注目するか?」をデータから「勝手に」学んでくれる方式だから。

つまり、エキスパートモデルの挫折の原因だった「人間がルールを書き足す」必要がなくなったってこと。

これによって、テキストだけでなく「画像」「音声」「動画」も行けちゃうようになり、一気にマルチモーダルが進んだ。

③細かい改良などではなく、ひたすらデータ量と計算量を増やすと「教えていないタスクを勝手に解決し始める」ようになった!

これ専門的に話すとめっちゃ難しい&長くなるので、ざっくり言うと、「物語の書き方を教えなくても、かなりいい感じの物語をLLMが突然作れるようになった」とか「犬の特徴を教えなくても、かなりいい感じの犬の画像を突然つくれるようになった」みたいなイメージ。

というわけで「何に注目すべきかを自動で学ばせてルールを半自動で作れる時代」がやって来たということ。

※「次へ→」をクリックして課題に進んでください